追光

论坛回复已创建

-

作者帖子

-

-

2026-01-09 - 11:39 #131057

追光参与者📌 日志 2:Parallels 打包(Packing / .pvmp)

问题

在 Parallels 控制中心点击「传输」,虚拟机进入 Packing(打包)状态。处理

• Packing 过程完成后生成 .pvmp 文件

• 原有 .pvm 虚拟机文件保持不变,未被修改结果

• .pvmp 为打包生成的压缩副本

• 仅用于虚拟机传输或备份

• 不参与日常运行,不能直接启动 Windows影响评估

• Packing ≠ Windows 真关机

• Packing 不影响系统更新状态

• Packing 与系统稳定性无直接关系备注

• 如无传输或备份需求,可直接删除 .pvmp 文件

• 删除 .pvmp 不会影响原 .pvm 虚拟机

✅ 情况二:需要保留备份

处理

• 保留 .pvmp 文件作为冷备份注意事项

• .pvmp 为静态打包文件,无法直接运行

• 恢复步骤:

• Parallels Desktop → 文件 → 打开

• 选择 .pvmp 文件

• Parallels 自动解包并生成新的 .pvm 虚拟机说明

• 解包生成的 .pvm 为独立副本

• 不会覆盖原有虚拟机 -

2026-01-06 - 21:25 #131052

追光参与者Mac中使用Parallels Desktop 安装的Windows,运行《无畏契约》 时提示DirectX 内部错误

Parallels 虚拟机里的 Windows 不能正常安装“官方 DirectX 运行库”

❌ DirectX Setup 报错是正常现象

✅ 不需要、也不应该手动装 DirectX你现在应该怎么做(重点)

✅ 第一步:安装 Parallels Tools(最关键)

在 Windows 虚拟机运行状态下:

Mac 菜单栏

1、Actions(操作) → Install Parallels Tools2、然后在 Windows 里一路 Next安装完成

3、重启 Windows

📌 Parallels Tools 里已经包含:DirectX 支持、OpenGL / Direct3D 转换层、显卡驱动。

-

2025-12-25 - 11:54 #131017

追光参与者2、将YouTube下载的VTT或者SRT字幕文件转换为标准VTT格式并增加中文翻译

当然,以下是将你提出的两个要求整合而成的一个清晰、标准的提示(prompt),可用于交由AI或字幕处理工具执行:

Prompt:

请将提供的 WEBVTT 字幕文件进行如下标准化处理:

1. 移除所有样式信息,包括但不限于 … 标签、align:、position: 等属性,仅保留纯文本内容。

2. 为每一行英文添加对应的中文翻译,置于其下方,形成“英文 + 中文”两行结构。

3. 每个时间戳块(cue)仅包含一行英文原文及其一行中文翻译。

如果原始字幕在同一时间戳内包含两行独立英文文本(例如第一行为前半句,第二行为后半句),则将第二行拆分为一个新的字幕块:

新块的开始时间设为原时间戳的结束时间;

新块的结束时间在开始时间基础上增加 1 毫秒(以确保时间不重叠且符合 WEBVTT 规范);

为新块的英文行同样添加对应的中文翻译。

4. 输出结果必须符合标准的 WEBVTT 格式,包含 WEBVTT 头部,且无多余空行或格式错误。请确保中文翻译准确、流畅,并尽可能保留原文的语境、节奏与诗意。

-

2025-12-24 - 17:43 #131005

追光参与者吉他同期录制立体声的便捷方法

在条件有限或希望快速获得立体声效果的情况下,可以通过拾音器 + 电容话筒的方式,实现吉他同期录制立体声,操作简单且实用。

录制思路

利用吉他拾音器与话筒各自不同的声音特性,将它们分别分配到左右声道,从而形成自然的立体声听感。

具体操作步骤

1、声道分配

• 将吉他拾音器(天音 T903)录制的信号,声像调整为左声道;

• 将电容话筒(AT2050)录制的信号,声像调整为右声道。这样可以在不额外增加设备的情况下,快速获得左右分离的立体声效果。

2、声相校正

由于拾音器与话筒在拾音位置和传播距离上存在差异,两个声道之间可能会出现声相偏移,严重时会导致相位抵消,从而使音色变薄、音量降低。为避免这一问题,可使用 Waves InPhase 插件对两个声道进行声相对位校正,使左右声道在时间与相位上更加一致,从而保证音质的完整性。

相关讨论与参考:

3、音量匹配与混音

在完成声相校正后,对左右声道进行音量匹配,使整体听感平衡。随后即可按照常规流程进行EQ、压缩、空间效果等混音处理。案例:吉他弹奏:季松斌,声卡:Apogee Duet2,Mic:AT2050 拾音器:天音T903,DAW:Ableton live

总结

这种“拾音器 + 电容话筒”的立体声录制方式,设备需求低、操作简洁,既保留了拾音器的清晰度,又兼顾了话筒的空间感,非常适合个人录音、Demo 制作或快速创作场景使用。二、俩只电容麦克风同期录制立体声(AT2050 俩只)

-

2025-12-09 - 15:46 #130966

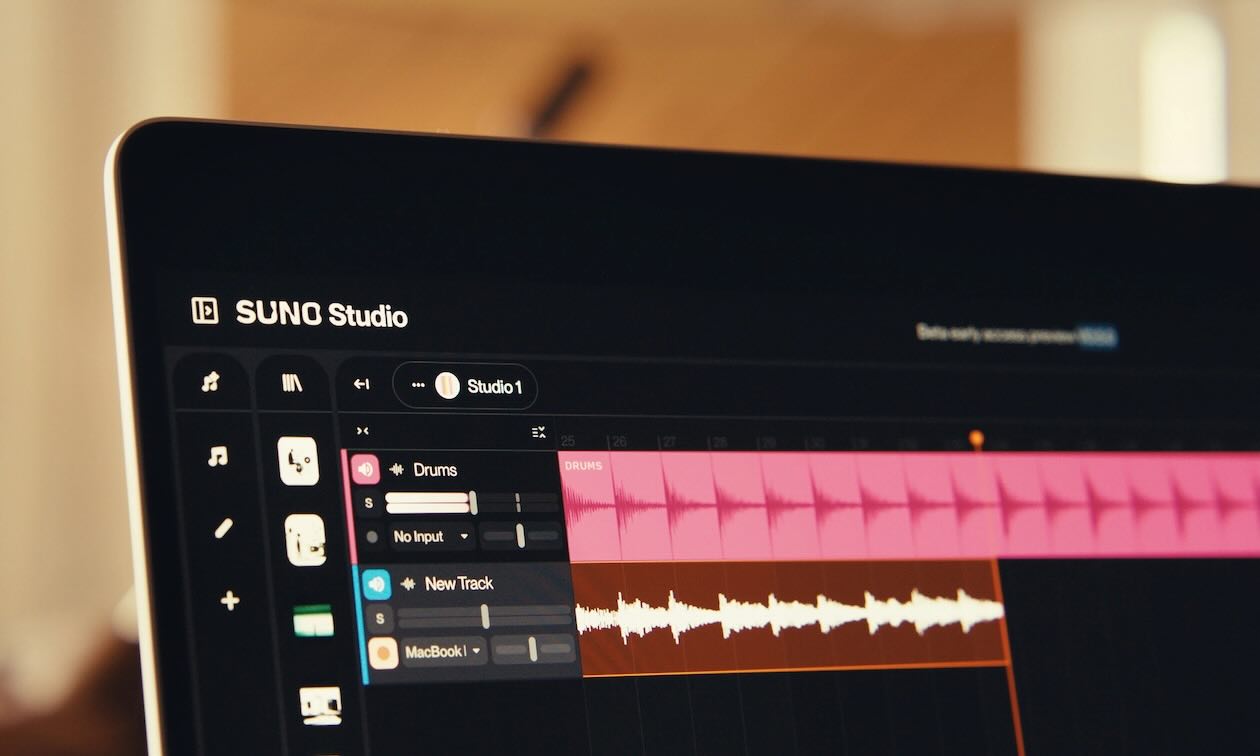

追光参与者下面是一份 最系统、最清晰、分步骤的《SUNO Studio 用法详解教程》。

结构从基础界面 → 功能 → 高级技巧,全流程讲清楚,适合新手和进阶用户。适用版本:Suno v3 / v3.5 / v4 / Suno Studio

格式清晰可直接实践。

📌 第一部分:进入 Suno Studio

步骤 1:打开 Suno Studio 页面

通常路径为:

• Suno 官方网站 → 选择 Studio

• 或直接从账户主页进入 “Create” 或 “Studio”

📌 第二部分:Suno Studio 界面说明

Studio 模式比普通生成器多出一些关键功能:

区域 功能

左侧:Track 列表 显示歌曲片段(Verse、Chorus…)

中间:编辑区域 对某段进行编辑、替换、扩展

右侧:设置栏 用于音色替换、歌词编辑、风格调整你可以把 Studio 理解为 AI 音轨编辑器,把每一段当成一个可编辑“片段”。

📌 第三部分:创建一首新歌(从零开始)

步骤 1:点击 “Create new song” / 新建歌曲

步骤 2:填写 Prompt(音乐风格提示)

Prompt 决定整体风格:

可以写:

• 曲风(Pop / Hip-hop / EDM / Cinematic)

• 情绪(sad, emotional, uplifting)

• 乐器(guitars, synths, piano)

• 主题(失恋、成长、自我觉醒)✔ 示例:

Emotional pop with atmospheric synths and strong vocals.

Theme: finding yourself again in a lonely city.步骤 3:填写歌词(可选)

你可以:

• 不填 → Suno 自动生成歌词

• 自己填 → 完整控制歌曲内容✔ Suno 支持的结构格式:

[Verse]

内容……[Chorus]

内容……步骤 4:点击 “Create”(生成)

Suno 会生成歌曲:通常包含 1 分钟左右。

📌 第四部分:使用 Studio 进行分段编辑

生成后就进入 Studio 核心功能。

🎚 1. 修改某一段的歌词

步骤:

1. 选中一个片段(如 Chorus)

2. 点击右侧 “Lyrics”

3. 修改歌词

4. 点击 “Regenerate”Suno 会保留旋律风格 + 节奏结构,但唱出你的新歌词。

🎚 2. 替换风格 / 音色(Style / Model / Voice)

每个段落的音色都能分开调整:

1. 选中一个片段

2. 右侧选择 Voice(主唱音色)

3. 或选择 Style/Genre(风格)

4. 点击 “Regenerate”✔ 你可以让副歌更爆发,主歌更温柔。

🎚 3. 扩展歌曲(Continue / Extend)

如果生成的歌曲太短,可继续生成。

做法:

• 在最后一段点击 “Continue from this track”

• 填写下一段的歌词或留空

• Suno 自动生成后续曲段这样可把 1 分钟扩展到 2–3 分钟甚至更长。

🎚 4. 替换某一段(Retry / Replace)

如果你不喜欢某段:

• 点击右侧 “Replace”

• 重新生成同位置的新段落不会影响其他段落。

🎚 5. 重混(Remix)整首歌

如果你想整体换风格:

• 点击顶部 “Remix song”

• 替换新的 Prompt

• Suno 会生成同主题但不同曲风版本

📌 第五部分:完整功能拆解(逐项说明)

以下是 Studio 最常用的功能按钮:

按钮 功能说明

Regenerate 根据新歌词/风格,重新生成本片段

Continue 继续下一段

Replace 替换整段但保持歌曲结构

Lyrics 编辑歌词

Prompt / Style 调整风格描述

Voice 替换歌手音色

Move Up / Down 片段顺序调整

Delete Track 删除该片段

Download 导出音频(mp3 或 wav)

📌 第六部分:Studio 的最佳实践

🎤 1. 副歌优先法

最好先生成一个超好听的副歌,再扩展主歌。

🧱 2. 段落控制节奏

建议结构:

Verse 1

Pre-Chorus

Chorus

Verse 2

Chorus

Bridge(可选)

Final Chorus🎧 3. 声音统一度优化

• 如果某段主唱太尖锐:换一个 voice

• 如果某段节奏偏差:重生成该段🎼 4. 歌词长度控制

中文每行 6–12 字最稳

英文每行 5–10 个单词最稳

📌 第七部分:完整示范(一步步操作)

以下是从零制作到导出成品的完整流程示例。

🎬 Step 1:输入 Prompt

Cinematic pop, spacious synths, emotional female vocal.

Theme: restarting life after a long night.

🎬 Step 2:输入 Lyrics

[Verse 1]

夜色在耳边低语

我走在城市的缝隙

风吹散了旧回忆

心却还在寻找自己[Chorus]

我会重新开始

哪怕路还很远

黑夜不会阻止我

我终将拥抱明天

🎬 Step 3:生成歌曲

得到 1 分钟小样。

🎬 Step 4:进入 Studio 调整

修改副歌歌词(让更爆发)

• 选中 Chorus → Lyrics → 填新内容 → Regenerate扩展第二段

• 选中最后一段 → Continue

• 输入 Verse 2 → 生成再扩展 Bridge → 再扩展 Final Chorus

🎬 Step 5:导出成品

右上角点击 Download。

歌曲完成。

-

2025-11-20 - 11:49 #130921

追光参与者在连接 MacBook 与 Dell U2720QM 等 4K 显示器时,线材选择至关重要。普通 USB-C 充电线(如 Apple 原装 100W 充电线)仅支持供电和 USB 2.0 数据,不支持视频输出,无法点亮显示器。

Thunderbolt 3/4 或 DP Alt Mode 的线缆全功能 USB-C 线(如支持 Thunderbolt 3/4 或 DP Alt Mode 的线缆)必须同时满足:

支持 DisplayPort 视频输出(DP 1.4,实现 4K@60Hz)

支持 USB 3.x 数据传输(使显示器 USB-A 接口可用)

支持 90W+ PD 供电(为 MacBook 充电)

雷电 4(Thunderbolt 4)线材

是全功能线的高端形态,除上述功能外,还支持:

40Gbps 高速数据传输

双 4K 显示输出

菊链扩展(Daisy Chain)

强制兼容 DP、USB、PD 协议 -

2025-10-19 - 00:01 #130826

追光参与者让Mac终端 Terminal中vim文件时候支持鼠标操作:

对于善于使用terminal的用户,经常会遇到vi或者vim时候不能使用鼠标移动光标,导致操作非常费劲,这里提供了一条命令让terminal支持鼠标的方法:

a:所有模式都启用鼠标,a 表示在所有模式下启用鼠标(普通、插入、可视、命令行等)Vim 终端支持的鼠标类型(xterm / urxvt / DEC / netterm)

echo 'set mouse=a' >> ~/.vimrc执行后即可开启,然后检验一下是否已经开启鼠标支持:

vim --version | grep mouse如果看到这俩条开启就表示已经支持vim中使用鼠标操作了:

mouse + Vim 主体支持鼠标

mouse_xterm + xterm / 兼容终端支持 -

2025-08-25 - 10:45 #130529

追光参与者2025年8月:对站点做了比较大的调整:1、首页的动态发布功能做了完全重构,现在会自动根据你关注的人、收藏的内容,把相关动态顶置在顶部;2、同时加上了动态类型筛选功能,方便快速找到想看的内容;3、个人主页也同步做了类似的改造;4、手机端体验重点优化,查阅、评论、回复都进行了重写,尽量保证和电脑端接近;

整体效果比以前顺畅很多,大家可以去关注、收藏试试,可能会有意想不到的小惊喜。

另外:SaaS的第二个重量级产品:用户自动建站(创建站点程序、Mysql适配PHP)、绑定域名(Nginx),以及特殊的增量磁盘精细到字节的管理、也都已经开发完毕,根据政策法规还不能直接开放使用,只能制定适合的规则、用户提交申请后给开放使用。

-

2025-08-10 - 18:48 #130299

追光参与者由于Nuke的Gzimo插件和py插件的使用方式和VFX流程当中基于python的开放式接口的插件保持了完全一样的方式,所以对于开发插件、安装插件都需要遵循其api标准,因此通过写代码的方式安装插件也成了基本配置,而写菜单代码这一项又需要学习Nuke的api接口规范增加了学习负担。

因此我根据Nuke的api标准写了一个在线自动写菜单代码的工具集成在NewVFX网站内,实现复制文件名即可写标准代码的能力。

Nuke在线写menu菜单自动化工具,使用方法仍然需要遵循上方教程中的方式插入到menu.py文件中。

支持 toolbar、addMenu、addCommand、导入模块等多种形式菜单创建。菜单生成支持单插件按钮、多插件子菜单、顶部主菜单、自定义面板等多种模式,可填写菜单名称、图标文件名、插件命令等参数,自动生成可直接运行的 Python 配置文件。

-

2025-11-27 - 12:08 #130932

追光参与者创建工程没有成功这个问题,没有遇到过,路径的话可以使用默认的,有读写权限的。启动软件要使用管理员身份启动。硬件或者配置一类的问题,需要结合实际,逐步排查,我们用的一直是mac系统,近十年来,目前没有遇到过类似问题。

-

2025-09-22 - 10:11 #130785

追光参与者优化关键帧一般情况下不建议使用,除非是手工修改关键帧。它仅仅是使用一套平缓的算法将数据做一个标准化处理,但是这种标准化在大多数时候并不能产生良好的效果,除非是轻微到像素级的漂移存在才会有良好的作用。

另外geometry track追踪的一般是以物体本身不会发生形变的几何形物体,轻微形变的刚体物质为主,而物体表面会发生形变的就要用到类似于表情追踪的深度追踪了。

追踪的方式是根据物理现实来决定的,所以设计追踪模式,制作标记球、布置追踪点,并进行拍摄素材与后期流程测试之后,才开始进行正式拍摄是基本流程,对于没有设计过儿进行拍摄的素材直接用于追踪,更加需要区分符合的追踪流程,遇到常规的追踪流程能够直接匹配追踪模式的就会得到很好的效果,但很难得到高质量的追踪结果。

-

2025-09-19 - 20:00 #130778

追光参与者1、追踪运动物体,比如手里拿个易拉罐或者其他物体在动,要追踪这个易拉罐的运动轨迹,这时候我们就可以用一个圆柱体的三维模型来匹配进行反向追踪。

2、上方的案例中是将场景中主要环境进行了简单建模,然后拿这个基础模型来对位实际拍摄的场景,进行反求。这样做其实是另外一个追踪思路。并不是我们常规的用特征点来计算场景,而是反过来,用重建的三维空间来对位真实拍摄到的空间进行反求。

这涉及到VFX制作中的流程问题了,要根据各个项目协作的状况来设计哪种追踪方式效果最好 还有效率最高,需要考虑到周围一起制作项目的人的习惯和方式。当然掌握各种追踪方式是非常有必要的,因为非常有意思,这些技术事实上是军用技术的非实时版。定位三维空间中的物体,其实就是雷达和定位的技术。比如定位飞机的坐标然后~~,所以3DEqualizer还有导入雷达数据的功能,也和这个使用模型反求类似。

-

2025-09-17 - 18:39 #130772

追光参与者畸变网格的主要作用是为了更加精确的畸变计算,没有畸变网格的情况3DEqualizer仍然可以按照画面进行计算或者手工绘制参数线段来实现更加精确的warp曲度计算。

也就是说,不管有没有畸变网格,畸变反求计算都是必备流程,因为这能大幅度提升提高计算的准确性。

然后最后就是导出到合成软件或者三维软件的问题:

三维软件比如houdini制作的画面都是没有畸变的,为了让其和物理镜头保持一致,我们会把计算3de计算出来的畸变渲染输出无畸变素材放到houdini当作预先合成背景参考:这样所有画面都是无畸变的。

在三维软件制作好渲染输出三维素材后,我们最终的合成是忠实于物理镜头的,将计算好的畸变数据添加到三维素材上+视频原始素材,最终所有画面都得到了和真实物理拍摄相机一致的畸变,更加真实。

因此畸变计算和传输是一一个过程,这三种方式都会用得到的。

-

2025-09-16 - 17:45 #130766

追光参与者可以的,这个问题也曾经困扰过我很久。即便你手上没有拍摄的畸变网格(grid),只要你在 3DEqualizer 里做了去畸变(undistort)或已经解出镜头畸变参数,就有几种把结果带到 Nuke 的常用办法。

1.直接导出“已去畸变”的素材(Undistorted plate)+ 对应相机(undistorted camera),使用3DEqualizer的warp模块就可以导出。

2.从 3DE 导出 STMap(或 GridWarp)并在 Nuke 用 STMap 节点重建畸变/去畸变。(PFtrack官方的专用流程就是用这个)

思路:3DE 可以导出一个 STMap(通常是 EXR),把它在 Nuke 的 STMap 或 GridWarp 流程里接回去,就能对任意图像做 undistort 或 redistort(互逆)。通常要准备两个 EXR:一个用于 undistort,一个用于 redistort(或按导出说明)。3.直接将畸变计算好的数据传输到Nuke,使用 3DE 的 Lens Distortion Plugin Kit(LDPK)或导出到 Nuke 的 LensDistortion 节点 / GridWarp 脚本。

-

2025-09-16 - 14:53 #130762

追光参与者非常感谢提醒,看来这个问题存在一周了,最近一直在开发站点功能,把这个执行代码给禁用了,看到你的火速进行了修复。现在视频和图片都能正常播放、查看啦~~谢谢你🙏,有问题疑问也可以发上来,共同学习进步哇~~

-

-

作者帖子