追光

@追光

15 分钟 前在线论坛回复已创建

-

作者帖子

-

-

2026-01-25 - 12:01 #131120

追光参与者Ableton Live 12.3 正式版新功能

Suite 版本新增「分轨分离」、Splice 深度集成、音频组整体导出、粘贴已渲染音频、全新自动声像/颤音效果器,以及更多实用更新。同时,Push 控制器也迎来大幅增强的演奏表现力,Move 设备库还加入了全新的鼓组和音效装置。无论是现场演出者、电子音乐人,还是影视配乐师,Live 12.3 都能让你更自由、更高效地把想法变成声音。

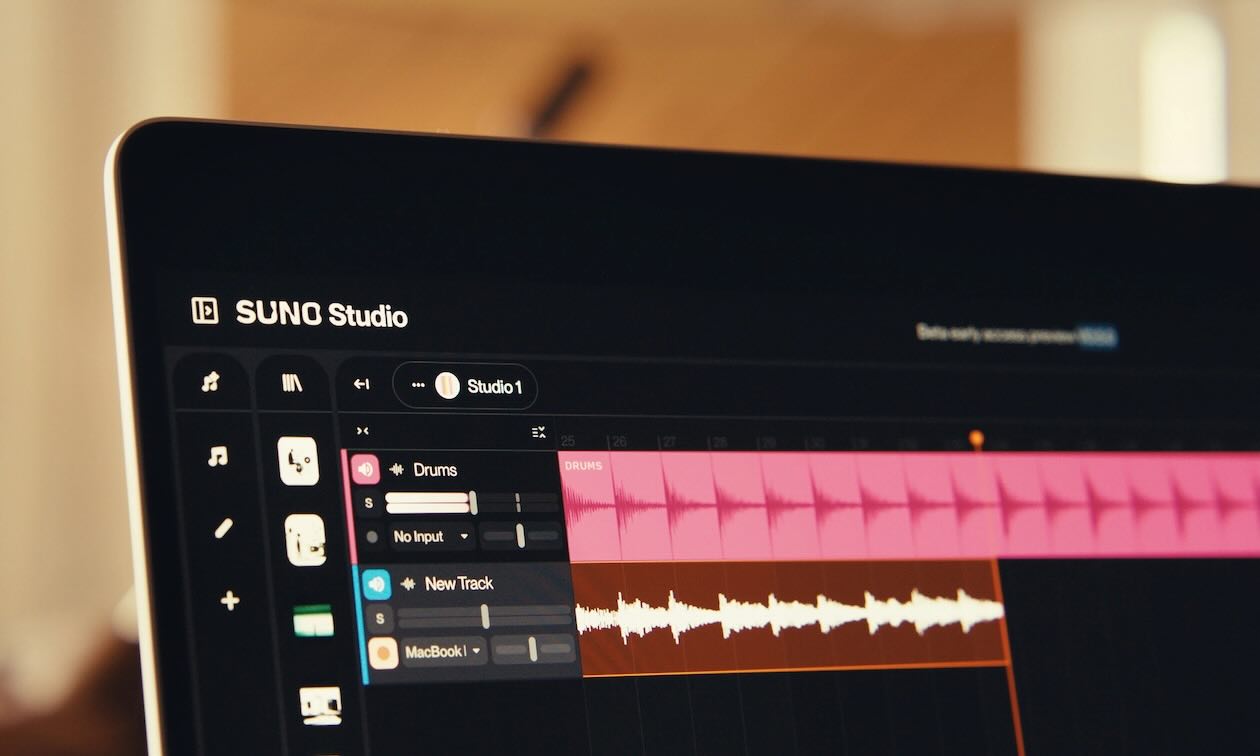

Screenshot

分轨分离(Stem Separation)(AI模型提取混音中的人声、鼓、bass等)

现在只需一键,就能从任意音频片段中智能分离出人声、鼓组、贝斯三大元素。

把一首完整作品“拆解”成原始素材,再自由重组无论是提取清唱、重做节奏,还是创造全新的混音结构,一切尽在掌控。Splice 原生集成

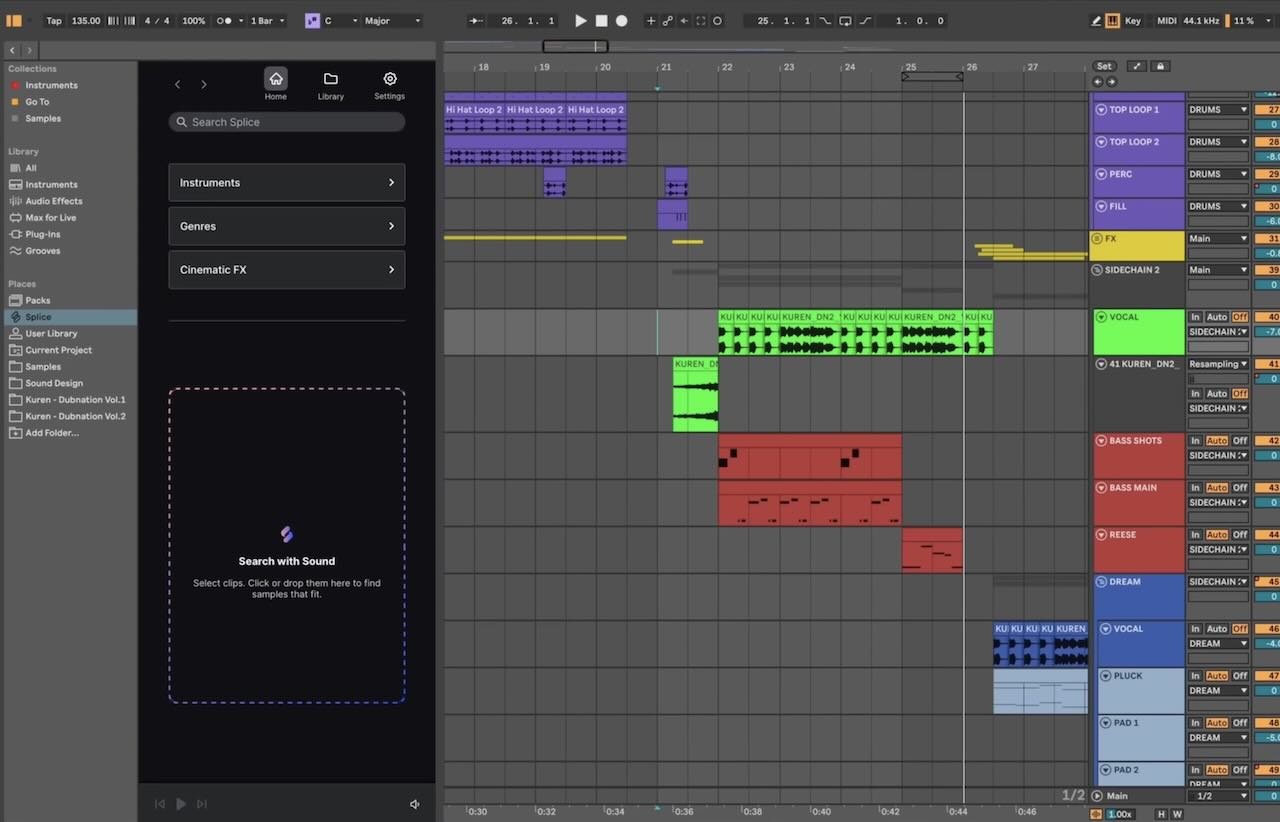

Splice 现已直接嵌入 Live 的浏览器中。可以在不切换窗口的情况下,实时试听 Splice 海量音色库中的采样,系统会自动将其与当前工程的节奏和调性对齐。

更酷的是,以声搜声(Search with Sound)功能,能根据你现有的音频元素,智能推荐风格契合的采样,让找声音变得像直觉一样快。

Screenshot

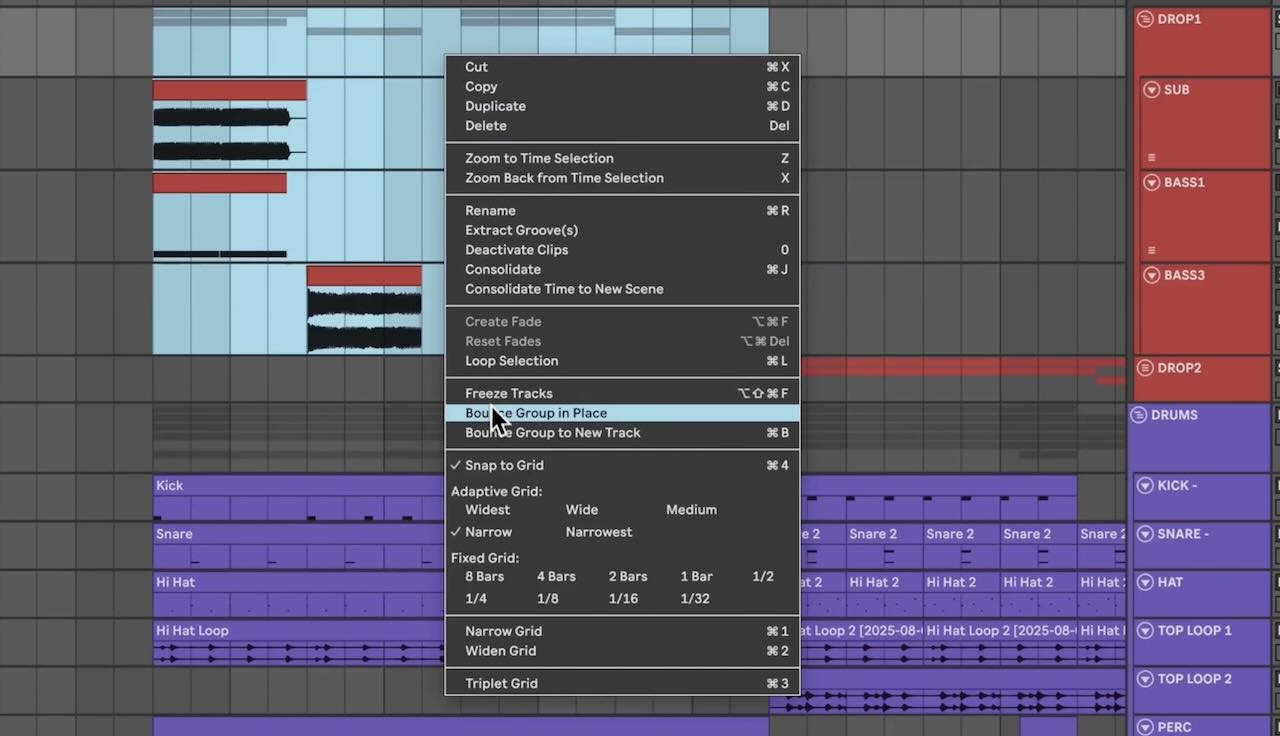

Bounced Audio升级

更高效的重采样与创意迭代:想要快速制作过渡效果、微调细节,或进行创意重采样?现在你可以直接将整个编组(Group)原位渲染为音频,或输出到新轨道;

也可以使用「粘贴已渲染音频(Paste Bounced Audio)」功能无需中断创作流程,就能快速生成想法的多个变体,反复打磨直到满意。

Screenshot

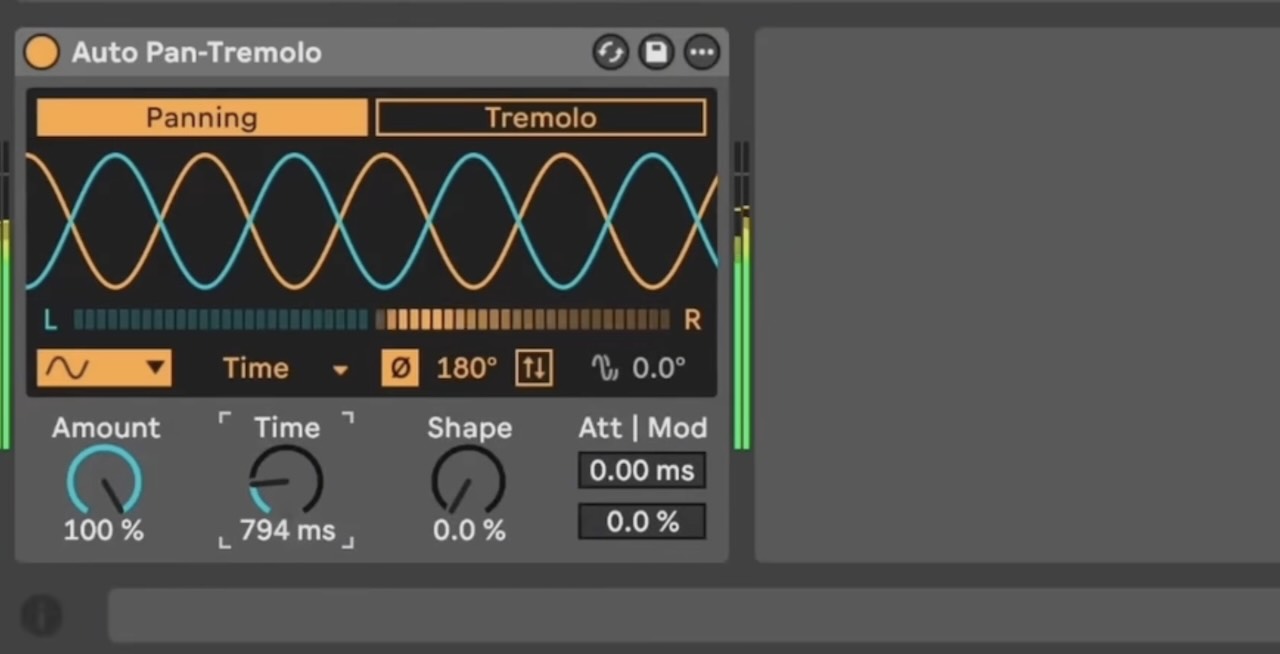

全新 Auto Pan-Tremolo 效果器

这款升级版声像/颤音效果器,不仅让经典颤音效果触手可及,还提供了更深层的调制选项与节奏同步控制。

配合新增的 A/B 对比功能,你可以即时切换两种混音处理或音色设计,直观感受差异,快速做出最佳选择。

Screenshot

全新 Max for Live 工具包:Generators by Iftah

Sting:源自广受好评的 Acid 贝斯线生成器,助你轻松打造律动感十足的低音线条;

Patterns:快速激发打击乐节奏灵感,几秒内生成复杂而富有动感的鼓点组合。📦 其他重要更新

Sequencers 音色包(自 Live 12.1 引入)现已支持可复现的编排结构,让随机生成也能保持一致性;

Expressive Chords 和弦装置(Live 12.2 新增)加入 Chord Edit 模式你可以直接选中和弦进行移调,或通过「学习(Learn)」功能,自定义输入你想要的和弦进行。 -

2026-01-23 - 09:47 #131112

追光参与者在 UVR(Ultimate Vocal Remover)测试版中的Roformer、SCNet 和 Bandit 模型

Roformer:基于旋转位置编码的Transformer,能精准捕捉人声与伴奏在频谱中的长程依赖关系和相位结构。对混响强、人声偏移、多和声的复杂歌曲表现显著优于旧模型。

SCNet(Spectral Complex Network):同时建模频谱的幅度 + 相位(传统模型只处理幅度),输出波形更自然,几乎无“金属感”伪影,人声边缘极其干净。

Bandit:轻量级但高效,采用频带自适应分离策略,在低资源下仍能保持高精度,特别适合高频细节(如齿音、气声)保留。一、Roformer 系列 当前分离质量天花板

基于频带拆分 + Transformer,细节保留极佳,适合高保真需求。最佳通用人声/伴奏分离

BS-Roformer-Viperx-1297

→ 分离干净、人声残留少、伴奏完整性高,综合最强,适合流行、电子、摇滚等多数风格。

MelBand Roformer Kim | Inst V2 by Unwa

→ 对复杂编曲(如交响、爵士)表现优异,乐器分离更自然,适合专业制作。特殊用途推荐

Karaoke MelBand Roformer (by aufr33 & viperx)

→ 专为人声+伴奏二分优化,适合 K 歌、翻唱。

BS Roformer Dereverb (anvuew edition)

→ 去混响效果目前最佳,适合修复现场录音或会议音频。提示:Roformer 模型对 GPU 显存要求较高(建议 ≥6GB),但质量远超传统模型。

二、SCNet 系列 轻量高效,适合快速处理

基于 Conv-TasNet 改进,速度快,资源占用低。最佳平衡选择

4-stems SCNet Large (by starrytong)

→ 在速度与质量间取得良好平衡,支持四轨分离(人声、鼓、贝斯、其他),适合批量处理或中低配设备。注意:SCNet-XL 虽参数更大,但提升有限,且易过拟合;Large 版本更实用。

三、Bandit 系列 影视/多语言音轨分离首选

专为电影、剧集、多语言内容设计,能分离对白、背景音乐、音效。最佳影视处理

Cinematic Bandit Plus (by kwatcharasupat)

→ 支持多语言对白提取,背景音乐/音效抑制强,影视工作者首选。

Cinematic Bandit v2 Multilang I

→ 多语言兼容性更好,适合非英语内容(如中文、日语剧集)。

四、其他专用模型

Phantom Centre extraction (by wesleyr36)→ 从中置声道精准提取人声(适合立体声混音),常用于修复老歌。总结推荐表(按用途)

用途———————推荐模型

最高质量人声/伴奏分离——–BS-Roformer-Viperx-1297 |

复杂编曲分离—————MelBand Roformer Kim \\| Inst V2 |

去混响 / 去回声————-BS Roformer Dereverb 或 UVR-DeEcho-DeReverb |

影视对白提取—————Cinematic Bandit Plus |

快速批量处理—————4-stems SCNet Large |

日常通用分离—————UVR-MDX-NET Main |

中置人声提取—————Phantom Centre extraction |

使用建议:

追求极致音质 → 选 Roformer(尤其 1297)。

处理影视/多语言 → 选 Bandit Plus。

设备性能有限 → 选 SCNet Large 或 MDX-NET Main。

需要音频修复(去混响/降噪)→ 优先用 FoxJoy 的 VR Arch 专用模型。当然我个人更推荐使用waves中的dereverb处理,具有百分百的手动控制能力。 -

2026-01-23 - 09:30 #131108

追光参与者UVR支持的完整模型分类清单以及uvr下载中心可下载的模型:

1. Demucs 系列(Meta 官方及衍生)

Demucs v4

htdemucsft

hdemucsmmi

htdemucs6s

Demucs v3

mdx

mdxq

mdxextra

mdxextraq

repromdxa

repromdxatimeonly

UVR Model(UVR 对 Demucs v3 的封装)

2. MDX-Net 系列(UVR 基于 Demucs v3 改进)

HQ(High Quality)系列

UVR-MDX-NET Inst HQ 1

UVR-MDX-NET Inst HQ 2

UVR-MDX-NET Inst HQ 4

UVR-MDX-NET Inst HQ 5

Main / Standard 系列

UVR-MDX-NET Main

UVR-MDX-NET Inst Main

基础系列

UVR-MDX-NET 1

UVR-MDX-NET 2

UVR-MDX-NET 3

UVR-MDX-NET Inst 1

3. VR Arch Single Model 系列(UVR 原生频域模型,非 Demucs 架构)

注:此系列基于频谱掩码(Spectral Subtraction / UNet-like)设计,常用于人声/伴奏分离、去噪、去混响等。

3.1 通用分离模型(HP / SP 命名)

HP 系列(High Precision)

2HP-UVR

3HP-Vocal-UVR

4HP-Vocal-UVR

5HP-Karaoke-UVR

6HP-Karaoke-UVR

7HP2-UVR

8HP2-UVR

9HP2-UVR

17HP-WindInst-UVR(专为风噪/乐器优化)

SP 系列(Standard Precision,多频段)

10SP-UVR-2B-32000-1

11SP-UVR-2B-32000-2

12SP-UVR-3B-44100

13SP-UVR-4B-44100-1

14SP-UVR-4B-44100-2

15SP-UVR-MID-44100-1

16SP-UVR-MID-44100-23.2 专用处理模型(由 FoxJoy 等开发者贡献)

去回声 / 去混响

UVR-De-Echo-Aggressive by FoxJoy

UVR-De-Echo-Normal by FoxJoy

UVR-DeEcho-DeReverb by FoxJoy(注:原文有拼写变体,统一为标准名)

降噪

UVR-DeNoise by FoxJoy

多轨影视音效分离(BVE = Background/Vocal/Effects)

UVR-BVE-4BSN-44100-13.3 MGM 系列(Multi-Genre Mastering,v4 版本)

MGMHIGHENDv4

MGMLOWENDAv4

MGMLOWENDBv4

MGMMAINv4MGM 系列针对不同频段(低频/高频)和音乐风格优化,适用于高质量母带级分离。

4. Roformer 系列(基于 Transformer 的先进分离器)

BS-Roformer(Band-Split)

BS-Roformer-Viperx-1297

BS-Roformer-Viperx-1296

BS-Roformer-Viperx-1053

BS-Roformer-Inst-EXP-Value-Residual (by Unwa)

MelBand Roformer(Mel 频带建模)

Mel-Roformer-Viperx-1143

MelBand Roformer Kim | Inst V1 by Unwa

MelBand Roformer Kim | Inst V2 by Unwa

MelBand Roformer Kim | InstVoc Duality V1 by Unwa

MelBand Roformer Kim | InstVoc Duality V2 by Unwa

MelBand Roformer Kim | Inst V1 (E) by Unwa

MelBand Roformer Kim(基础版)

特殊用途

Karaoke MelBand Roformer (by aufr33 & viperx)

BS Roformer Dereverb (anvuew edition)

5. SCNet 系列(Conv-TasNet 衍生)

4-stems SCNetMUSDB18 (by starrytong)

4-stems SCNet Large (by starrytong)

4-stems SCNet-XL

6. 其他专用模型

Phantom Centre extraction (by wesleyr36) 中置声道提取

Cinematic Bandit Plus (by kwatcharasupat)

Cinematic Bandit v2 Multilang I (by kwatcharasupat) -

2026-01-21 - 23:27 #131086

追光参与者方法一|默认就好用(省心),大多数歌曲

步骤:

htdemucs_ft → 完成

判断: 听起来自然 = 停手

原则: 不追求一次就“最干净”方法二|人声更清晰(专业)

人声重要 / remix

步骤:

htdemucs_ft → UVR-MDX-NET Main

用法:

• 以 Demucs 人声为主

• MDX 只补高频方法三|伴奏最干净(工程)

卡拉 OK / 商用

步骤:

UVR-MDX-NET Inst HQ 1

不够干净 → Inst HQ 2

原则: 宁可干,不要人声残留 -

2026-01-09 - 11:41 #131059

追光参与者📌 日志 4:Parallels 关机不是真关机

问题:控制中心“关机”实际为保存状态(非 S5)。

处理方法:在 Windows 内执行:

shutdown /s /t 0结果:Windows 完全关机,适合创建快照和长期稳定使用。

-

2026-01-09 - 11:40 #131058

追光参与者日志 3:Parallels 权限弹窗反复出现

问题

每次启动 Windows 都弹出“Parallels Desktop” would like to access data from other apps.

Keeping app data separate makes it easier to manage your privacy and security.

原因:macOS 未为 Parallels 设置永久隐私权限。

处理

在 macOS「隐私与安全性」–完全磁盘访问中,为 Parallels 开启:

• 文件与文件夹访问

• 完全磁盘访问结果:权限固定放行,弹窗不再出现。

-

2026-01-09 - 11:39 #131057

追光参与者📌 日志 2:Parallels 打包(Packing / .pvmp)

问题

在 Parallels 控制中心点击「传输」,虚拟机进入 Packing(打包)状态。处理

• Packing 过程完成后生成 .pvmp 文件

• 原有 .pvm 虚拟机文件保持不变,未被修改结果

• .pvmp 为打包生成的压缩副本

• 仅用于虚拟机传输或备份

• 不参与日常运行,不能直接启动 Windows影响评估

• Packing ≠ Windows 真关机

• Packing 不影响系统更新状态

• Packing 与系统稳定性无直接关系备注

• 如无传输或备份需求,可直接删除 .pvmp 文件

• 删除 .pvmp 不会影响原 .pvm 虚拟机

✅ 情况二:需要保留备份

处理

• 保留 .pvmp 文件作为冷备份注意事项

• .pvmp 为静态打包文件,无法直接运行

• 恢复步骤:

• Parallels Desktop → 文件 → 打开

• 选择 .pvmp 文件

• Parallels 自动解包并生成新的 .pvm 虚拟机说明

• 解包生成的 .pvm 为独立副本

• 不会覆盖原有虚拟机 -

2026-01-06 - 21:25 #131052

追光参与者Mac中使用Parallels Desktop 安装的Windows,运行《无畏契约》 时提示DirectX 内部错误

Parallels 虚拟机里的 Windows 不能正常安装“官方 DirectX 运行库”

❌ DirectX Setup 报错是正常现象

✅ 不需要、也不应该手动装 DirectX你现在应该怎么做(重点)

✅ 第一步:安装 Parallels Tools(最关键)

在 Windows 虚拟机运行状态下:

Mac 菜单栏

1、Actions(操作) → Install Parallels Tools2、然后在 Windows 里一路 Next安装完成

3、重启 Windows

📌 Parallels Tools 里已经包含:DirectX 支持、OpenGL / Direct3D 转换层、显卡驱动。

-

2025-12-25 - 11:54 #131017

追光参与者2、将YouTube下载的VTT或者SRT字幕文件转换为标准VTT格式并增加中文翻译

当然,以下是将你提出的两个要求整合而成的一个清晰、标准的提示(prompt),可用于交由AI或字幕处理工具执行:

Prompt:

请将提供的 WEBVTT 字幕文件进行如下标准化处理:

1. 移除所有样式信息,包括但不限于 … 标签、align:、position: 等属性,仅保留纯文本内容。

2. 为每一行英文添加对应的中文翻译,置于其下方,形成“英文 + 中文”两行结构。

3. 每个时间戳块(cue)仅包含一行英文原文及其一行中文翻译。

如果原始字幕在同一时间戳内包含两行独立英文文本(例如第一行为前半句,第二行为后半句),则将第二行拆分为一个新的字幕块:

新块的开始时间设为原时间戳的结束时间;

新块的结束时间在开始时间基础上增加 1 毫秒(以确保时间不重叠且符合 WEBVTT 规范);

为新块的英文行同样添加对应的中文翻译。

4. 输出结果必须符合标准的 WEBVTT 格式,包含 WEBVTT 头部,且无多余空行或格式错误。请确保中文翻译准确、流畅,并尽可能保留原文的语境、节奏与诗意。

-

2025-12-24 - 17:43 #131005

追光参与者吉他同期录制立体声的便捷方法

在条件有限或希望快速获得立体声效果的情况下,可以通过拾音器 + 电容话筒的方式,实现吉他同期录制立体声,操作简单且实用。

录制思路

利用吉他拾音器与话筒各自不同的声音特性,将它们分别分配到左右声道,从而形成自然的立体声听感。

具体操作步骤

1、声道分配

• 将吉他拾音器(天音 T903)录制的信号,声像调整为左声道;

• 将电容话筒(AT2050)录制的信号,声像调整为右声道。这样可以在不额外增加设备的情况下,快速获得左右分离的立体声效果。

2、声相校正

由于拾音器与话筒在拾音位置和传播距离上存在差异,两个声道之间可能会出现声相偏移,严重时会导致相位抵消,从而使音色变薄、音量降低。为避免这一问题,可使用 Waves InPhase 插件对两个声道进行声相对位校正,使左右声道在时间与相位上更加一致,从而保证音质的完整性。

相关讨论与参考:

3、音量匹配与混音

在完成声相校正后,对左右声道进行音量匹配,使整体听感平衡。随后即可按照常规流程进行EQ、压缩、空间效果等混音处理。案例:吉他弹奏:季松斌,声卡:Apogee Duet2,Mic:AT2050 拾音器:天音T903,DAW:Ableton live

总结

这种“拾音器 + 电容话筒”的立体声录制方式,设备需求低、操作简洁,既保留了拾音器的清晰度,又兼顾了话筒的空间感,非常适合个人录音、Demo 制作或快速创作场景使用。二、俩只电容麦克风同期录制立体声(AT2050 俩只)

-

2025-12-09 - 15:46 #130966

追光参与者下面是一份 最系统、最清晰、分步骤的《SUNO Studio 用法详解教程》。

结构从基础界面 → 功能 → 高级技巧,全流程讲清楚,适合新手和进阶用户。适用版本:Suno v3 / v3.5 / v4 / Suno Studio

格式清晰可直接实践。

📌 第一部分:进入 Suno Studio

步骤 1:打开 Suno Studio 页面

通常路径为:

• Suno 官方网站 → 选择 Studio

• 或直接从账户主页进入 “Create” 或 “Studio”

📌 第二部分:Suno Studio 界面说明

Studio 模式比普通生成器多出一些关键功能:

区域 功能

左侧:Track 列表 显示歌曲片段(Verse、Chorus…)

中间:编辑区域 对某段进行编辑、替换、扩展

右侧:设置栏 用于音色替换、歌词编辑、风格调整你可以把 Studio 理解为 AI 音轨编辑器,把每一段当成一个可编辑“片段”。

📌 第三部分:创建一首新歌(从零开始)

步骤 1:点击 “Create new song” / 新建歌曲

步骤 2:填写 Prompt(音乐风格提示)

Prompt 决定整体风格:

可以写:

• 曲风(Pop / Hip-hop / EDM / Cinematic)

• 情绪(sad, emotional, uplifting)

• 乐器(guitars, synths, piano)

• 主题(失恋、成长、自我觉醒)✔ 示例:

Emotional pop with atmospheric synths and strong vocals.

Theme: finding yourself again in a lonely city.步骤 3:填写歌词(可选)

你可以:

• 不填 → Suno 自动生成歌词

• 自己填 → 完整控制歌曲内容✔ Suno 支持的结构格式:

[Verse]

内容……[Chorus]

内容……步骤 4:点击 “Create”(生成)

Suno 会生成歌曲:通常包含 1 分钟左右。

📌 第四部分:使用 Studio 进行分段编辑

生成后就进入 Studio 核心功能。

🎚 1. 修改某一段的歌词

步骤:

1. 选中一个片段(如 Chorus)

2. 点击右侧 “Lyrics”

3. 修改歌词

4. 点击 “Regenerate”Suno 会保留旋律风格 + 节奏结构,但唱出你的新歌词。

🎚 2. 替换风格 / 音色(Style / Model / Voice)

每个段落的音色都能分开调整:

1. 选中一个片段

2. 右侧选择 Voice(主唱音色)

3. 或选择 Style/Genre(风格)

4. 点击 “Regenerate”✔ 你可以让副歌更爆发,主歌更温柔。

🎚 3. 扩展歌曲(Continue / Extend)

如果生成的歌曲太短,可继续生成。

做法:

• 在最后一段点击 “Continue from this track”

• 填写下一段的歌词或留空

• Suno 自动生成后续曲段这样可把 1 分钟扩展到 2–3 分钟甚至更长。

🎚 4. 替换某一段(Retry / Replace)

如果你不喜欢某段:

• 点击右侧 “Replace”

• 重新生成同位置的新段落不会影响其他段落。

🎚 5. 重混(Remix)整首歌

如果你想整体换风格:

• 点击顶部 “Remix song”

• 替换新的 Prompt

• Suno 会生成同主题但不同曲风版本

📌 第五部分:完整功能拆解(逐项说明)

以下是 Studio 最常用的功能按钮:

按钮 功能说明

Regenerate 根据新歌词/风格,重新生成本片段

Continue 继续下一段

Replace 替换整段但保持歌曲结构

Lyrics 编辑歌词

Prompt / Style 调整风格描述

Voice 替换歌手音色

Move Up / Down 片段顺序调整

Delete Track 删除该片段

Download 导出音频(mp3 或 wav)

📌 第六部分:Studio 的最佳实践

🎤 1. 副歌优先法

最好先生成一个超好听的副歌,再扩展主歌。

🧱 2. 段落控制节奏

建议结构:

Verse 1

Pre-Chorus

Chorus

Verse 2

Chorus

Bridge(可选)

Final Chorus🎧 3. 声音统一度优化

• 如果某段主唱太尖锐:换一个 voice

• 如果某段节奏偏差:重生成该段🎼 4. 歌词长度控制

中文每行 6–12 字最稳

英文每行 5–10 个单词最稳

📌 第七部分:完整示范(一步步操作)

以下是从零制作到导出成品的完整流程示例。

🎬 Step 1:输入 Prompt

Cinematic pop, spacious synths, emotional female vocal.

Theme: restarting life after a long night.

🎬 Step 2:输入 Lyrics

[Verse 1]

夜色在耳边低语

我走在城市的缝隙

风吹散了旧回忆

心却还在寻找自己[Chorus]

我会重新开始

哪怕路还很远

黑夜不会阻止我

我终将拥抱明天

🎬 Step 3:生成歌曲

得到 1 分钟小样。

🎬 Step 4:进入 Studio 调整

修改副歌歌词(让更爆发)

• 选中 Chorus → Lyrics → 填新内容 → Regenerate扩展第二段

• 选中最后一段 → Continue

• 输入 Verse 2 → 生成再扩展 Bridge → 再扩展 Final Chorus

🎬 Step 5:导出成品

右上角点击 Download。

歌曲完成。

-

2025-11-20 - 11:49 #130921

追光参与者在连接 MacBook 与 Dell U2720QM 等 4K 显示器时,线材选择至关重要。普通 USB-C 充电线(如 Apple 原装 100W 充电线)仅支持供电和 USB 2.0 数据,不支持视频输出,无法点亮显示器。

Thunderbolt 3/4 或 DP Alt Mode 的线缆全功能 USB-C 线(如支持 Thunderbolt 3/4 或 DP Alt Mode 的线缆)必须同时满足:

支持 DisplayPort 视频输出(DP 1.4,实现 4K@60Hz)

支持 USB 3.x 数据传输(使显示器 USB-A 接口可用)

支持 90W+ PD 供电(为 MacBook 充电)

雷电 4(Thunderbolt 4)线材

是全功能线的高端形态,除上述功能外,还支持:

40Gbps 高速数据传输

双 4K 显示输出

菊链扩展(Daisy Chain)

强制兼容 DP、USB、PD 协议 -

2025-10-19 - 00:01 #130826

追光参与者让Mac终端 Terminal中vim文件时候支持鼠标操作:

对于善于使用terminal的用户,经常会遇到vi或者vim时候不能使用鼠标移动光标,导致操作非常费劲,这里提供了一条命令让terminal支持鼠标的方法:

a:所有模式都启用鼠标,a 表示在所有模式下启用鼠标(普通、插入、可视、命令行等)Vim 终端支持的鼠标类型(xterm / urxvt / DEC / netterm)

echo 'set mouse=a' >> ~/.vimrc执行后即可开启,然后检验一下是否已经开启鼠标支持:

vim --version | grep mouse如果看到这俩条开启就表示已经支持vim中使用鼠标操作了:

mouse + Vim 主体支持鼠标

mouse_xterm + xterm / 兼容终端支持 -

2025-11-27 - 12:08 #130932

追光参与者创建工程没有成功这个问题,没有遇到过,路径的话可以使用默认的,有读写权限的。启动软件要使用管理员身份启动。硬件或者配置一类的问题,需要结合实际,逐步排查,我们用的一直是mac系统,近十年来,目前没有遇到过类似问题。

-

2025-09-22 - 10:11 #130785

追光参与者优化关键帧一般情况下不建议使用,除非是手工修改关键帧。它仅仅是使用一套平缓的算法将数据做一个标准化处理,但是这种标准化在大多数时候并不能产生良好的效果,除非是轻微到像素级的漂移存在才会有良好的作用。

另外geometry track追踪的一般是以物体本身不会发生形变的几何形物体,轻微形变的刚体物质为主,而物体表面会发生形变的就要用到类似于表情追踪的深度追踪了。

追踪的方式是根据物理现实来决定的,所以设计追踪模式,制作标记球、布置追踪点,并进行拍摄素材与后期流程测试之后,才开始进行正式拍摄是基本流程,对于没有设计过儿进行拍摄的素材直接用于追踪,更加需要区分符合的追踪流程,遇到常规的追踪流程能够直接匹配追踪模式的就会得到很好的效果,但很难得到高质量的追踪结果。

-

-

作者帖子